关键要点

- 推理性能和成本越来越受到内存和数据移动的影响

- 智能体人工智能需要持久的、长期存在的上下文信息,这需要大容量硬盘存储空间。

- 多层架构(硬盘驱动器 + GPU 内存 + NVMe SSD)有助于在不造成成本失控的情况下扩展上下文。

智能体人工智能已成为下一个具有价值的运营前沿领域。

组织领导者需要能够规划、行动并随着时间推移而改进的人工智能系统——能够执行多步骤工作流程并交付关键业务成果的代理。

但随着复杂性和查询量的增加,这些代理所依赖的上下文保留能力的局限性变得越来越不容忽视。

智能体可能会变得健忘——不是因为模型本身能力不足,而是因为其可用的、持久的上下文记忆有限。

人工智能生态系统对此有一个专门的名称:上下文墙。

上下文墙是指代理缺乏工作上下文,不得不总结、丢弃信息,或者反复检索和重新检查先前访问过的事实。这会减慢推理速度,增加成本,而且往往会降低质量。结果:答案前后矛盾,讨论线索丢失。

上下文墙很快就会变成一个业务问题。它显示为:

- 更高的计算成本(更多返工、更多检索周期、更多令牌)

- 响应速度较慢(重新计算或重新加载上下文造成的延迟)

- 信任度较低(不同会话间行为不一致)

- 能力限制(智能体无法维持长期任务)

扩展上下文范围只是部分地为了改进模型。这主要关乎你如何存储和提供上下文信息。

智能体人工智能的联合解决方案

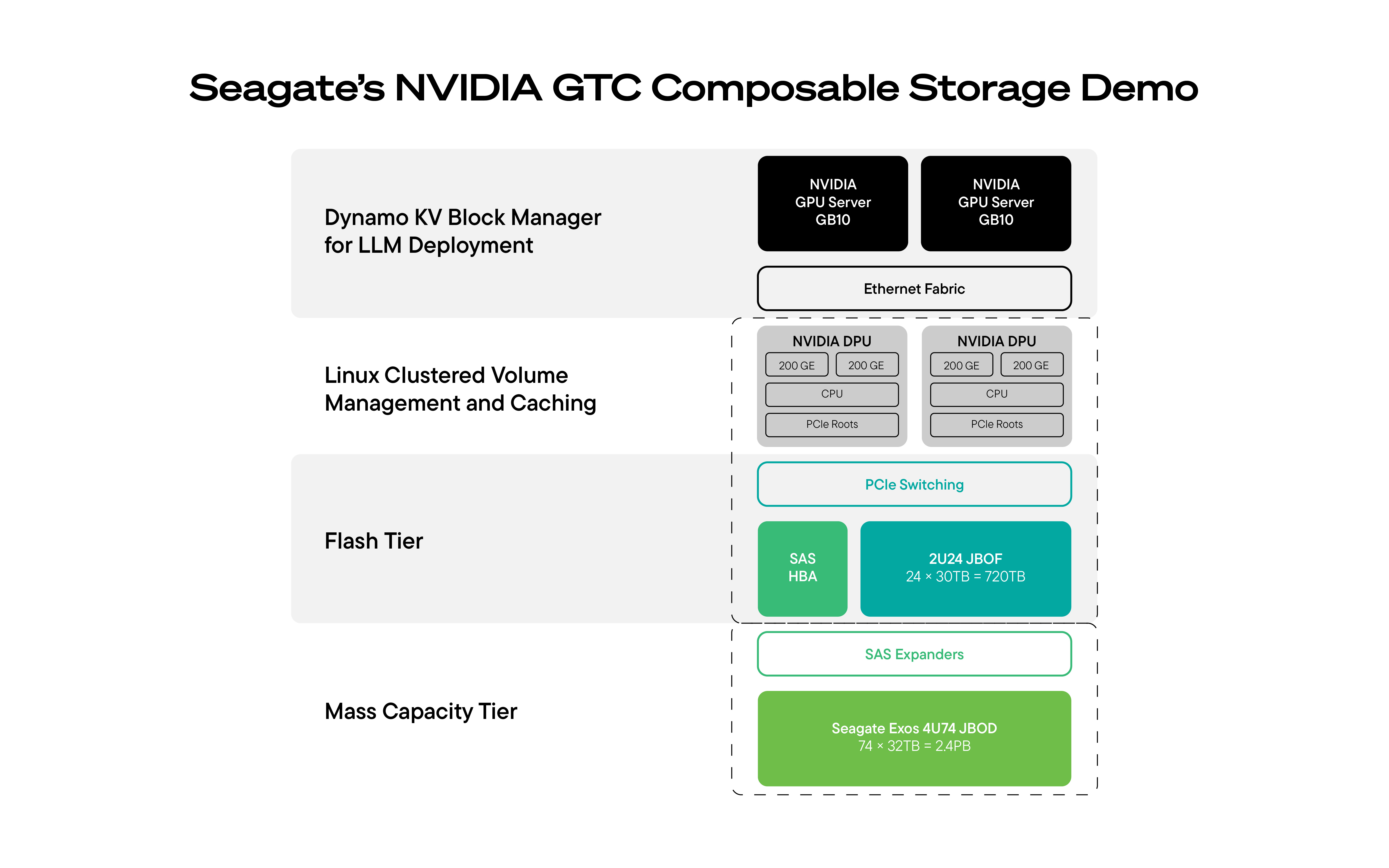

为应对这一挑战,Seagate 及其合作伙伴在 NVIDIA GTC 上推出了一款可商用、可投入生产的多层级 AI 存储解决方案,旨在为 AI 工作负载扩展上下文能力。

GTC 上展示的解决方案结合了:

这种架构之所以重要,不仅是因为它扩展了上下文,还因为它重新定义了组织应该如何看待人工智能推理经济学。一旦代理工作负载进入生产环境,内存和数据移动就成为性能、成本和可靠性的核心,而不仅仅是模型质量的核心。

Supermicro EMEA 总裁兼总经理、技术和人工智能高级副总裁 Vik Malyala 表示:“将 Supermicro 的 JBOF 闪存层与 Seagate 的硬盘层相结合,可以大幅降低推理成本,同时提供高性能。”“随着智能体人工智能的广泛应用和推理工作负载的指数级增长,这一点尤为重要。”

将记忆转化为竞争优势

这里有一个很容易被忽视的转变:推理正变得越来越像一个内存问题,而不仅仅是一个计算问题。GPU 功能强大,但要发挥其应有的效用,就需要以合适的速度、在合适的时间以合适的成本提供合适的数据。

代理程序渴望获得更多上下文信息存储。除了提示信息外,他们还需要跟踪以下内容:

- 漫长的对话和决策过程

- 政策和程序

- 产品和故障排除知识

- 日志、工单和遥测数据

试图将所有这些都保留在即时访问层(GPU 内存或全闪存)就像坚持让整个公司都使用高级当日送达服务一样:对于少量包裹来说很好;但规模化后在经济上是荒谬的。

成功的方案依赖于多层永久存储架构。

为什么多层存储是切实可行的解决方案

智能AI堆栈将短期记忆和长期记忆分开,并让每一层发挥其最擅长的作用:

- 实时访问层级(GPU HBM 内存、CPU DRAM、本地和网络 NVMe SSD):处理当前上下文——活动令牌、热嵌入和频繁访问的数据

- 容量层级(由硬盘构建):保存长期上下文信息——大型数据集、长期历史记录和扩展的代理内存

商业价值源于一个简单的原则:自动化所有层级的数据放置。让 GPU 保持高负载运行,控制成本,并深入理解上下文。

DPU如何优化数据平面

从历史上看,将人工智能的性能等级和容量等级结合起来一直很混乱。它通常需要复杂的专有文件系统、大量的 CPU 开销和脆弱的调优——尤其是在数据量激增的情况下。

由于数据处理单元(DPU)的出现,这种情况正在发生改变。

DPU 可以卸载并加速数据传输,因此系统不会仅仅为了移动字节而消耗主机 CPU 周期。它们能够实现高速网络和存储访问模式,并且可以运行基于 Linux 的标准服务,用于缓存、分层、弹性和安全性。简而言之,DPU 有助于实现多层 AI 存储的部署和可扩展性。

这就是为什么多层设计能够在生产规模上行得通的原因。

多层架构能够实现什么

Seagate、Supermicro 和 NVIDIA 的架构将扩展 AI 环境所需的核心组件整合在一起,从而能够以经济高效的方式大规模扩展 AI 环境:GPU 计算用于推理,硬盘用于存储大容量、长寿命的上下文信息,NVMe SSD 用于即时访问,DPU 用于协调跨层的数据移动和缓存。

这种组合能够促进客户最关心的业务成果。

更深层次的代理上下文意味着更好的商业价值

这种方法对客户意味着什么?

1.更好的代理存储记忆——以及更好的结果

代理可以访问比 GPU 邻近存储所能容纳的更多的历史数据。这样可以支持更长远的推理、更丰富的个性化以及减少因遗忘上下文而导致的失败。

2.降低规模化成本

硬盘驱动器为长期存储提供了每TB极低的成本。这一点很重要,因为数据集和代理历史记录会不断增长。

3.效率是下一个优化前沿

组织会跟踪性能(每秒令牌数)以及效率,包括每个令牌的功耗和持续 GPU 利用率等指标。多层设计有助于减少浪费的工作(重新加载、重新处理、重新检索),并保持 GPU 的高效运行。

4.与人工智能基础设施发展方向保持一致

DPU驱动的数据平面正成为现代人工智能系统设计的核心。这种方法与这个方向一致:构建可扩展的数据交付体系,而不仅仅是原始计算能力。

用事实说话,而非空头承诺:GTC演示及后续内容

在 GTC 大会上,该架构在一个运行的系统中得到了演示——GPU 用于推理,硬盘用于海量、深度上下文信息,SSD 用于即时访问,DPU 用于协调高效的数据移动和缓存。

人工智能仍处于发展初期。它将继续消耗和产生海量数据。Seagate、Supermicro 和 NVIDIA 正共同以更具永续性、更高效率、并可大规模扩展的架构来推动这一未来。

能够成功扩展代理规模的组织,将会把上下文视为战略资产,并构建能够高效存储和提供上下文的基础设施。

与专家洽谈,了解 Seagate 如何帮助您的组织突破自主式 AI 的上下文扩展瓶颈。

-v4.png/_jcr_content/renditions/4-3-small-416x312.png)