Puntos clave para recordar

- El rendimiento y el coste de la inferencia dependen cada vez más de la memoria y el movimiento de datos.

- La IA agente requiere un contexto persistente y de larga duración, que necesita almacenamiento en disco duro de gran capacidad.

- Las arquitecturas de múltiples niveles (discos duros + memoria GPU + SSD NVMe) ayudan a escalar el contexto sin un costo desorbitado.

La IA agente se ha erigido como la próxima frontera operativa de la creación de valor.

Los líderes de las organizaciones necesitan sistemas de IA que puedan planificar, actuar y mejorar con el tiempo: agentes que ejecuten flujos de trabajo de varios pasos y ofrezcan resultados empresariales cruciales.

Pero a medida que aumenta la complejidad y el volumen de consultas, los límites de la retención de contexto en los que se basan esos agentes se vuelven difíciles de ignorar.

Los agentes pueden volverse olvidadizos, no porque el modelo no sea capaz, sino porque su memoria de contexto utilizable y persistente es limitada.

El ecosistema de IA tiene un nombre para esto: el muro de contexto.

El límite de contexto es el punto en el que un agente se queda sin contexto de trabajo y tiene que resumir, descartar información o recuperar y volver a comprobar repetidamente los datos a los que ya había accedido. Eso ralentiza la inferencia, aumenta el coste y, a menudo, degrada la calidad. El resultado: respuestas inconsistentes y pérdida de hilo de la conversación.

El muro de contexto se convierte rápidamente en un problema empresarial. Aparece como:

- Costos de procesamiento más elevados (más retrabajo, más ciclos de recuperación, más tokens).

- Respuestas más lentas (latencia debida al recálculo o la recarga del contexto)

- Menor confianza (comportamiento inconsistente entre sesiones)

- Limitaciones en la capacidad (los agentes no pueden realizar tareas a largo plazo).

Ampliar el alcance del contexto no solo se trata, en parte, de mejorar los modelos. Se trata principalmente de cómo se almacena y se sirve el contexto.

La solución conjunta para la IA agente

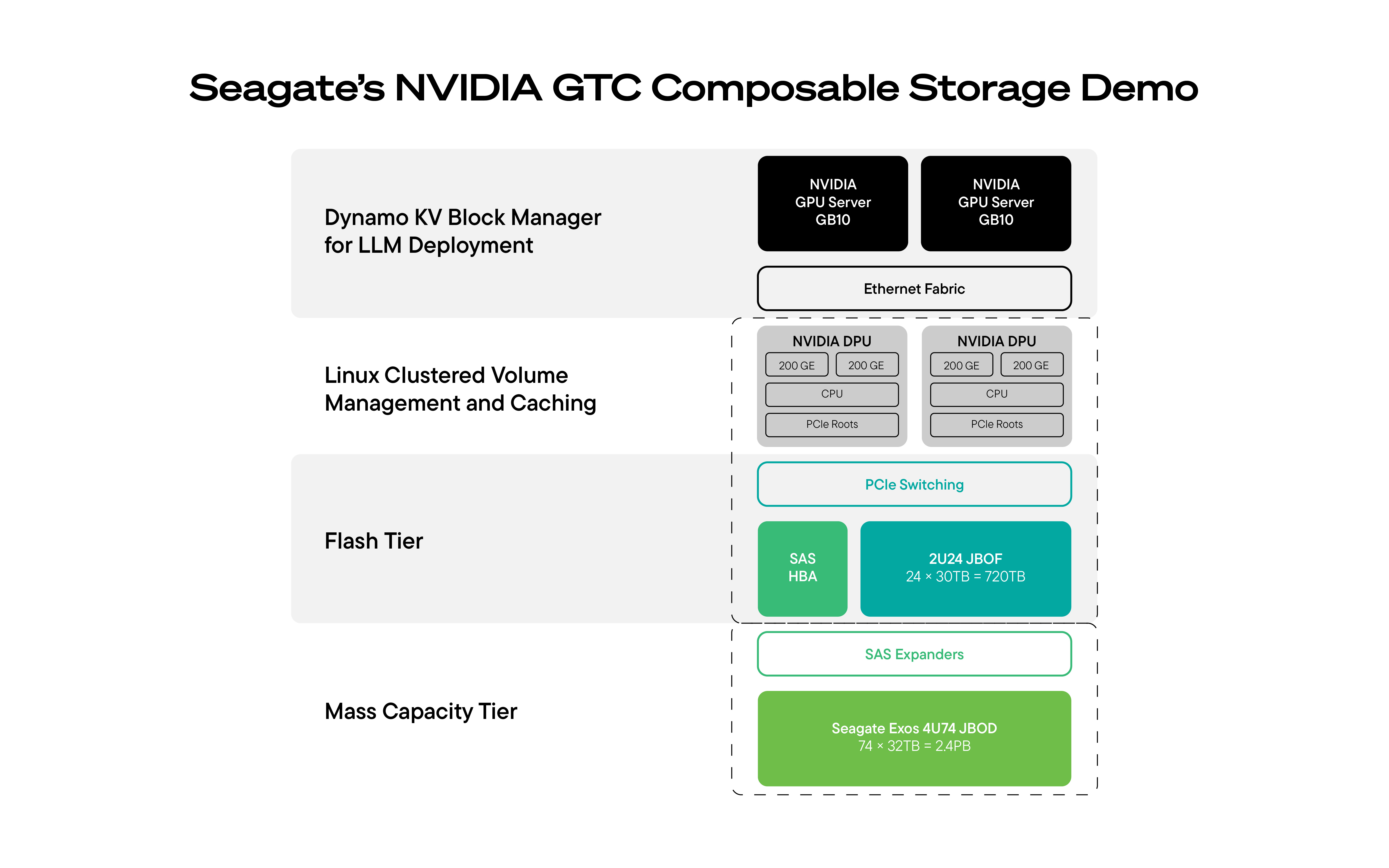

Para abordar este desafío, Seagate y sus socios presentaron en la conferencia NVIDIA GTC una solución de almacenamiento de IA multinivel, disponible comercialmente y lista para la producción, diseñada para ampliar el contexto de las cargas de trabajo de IA.

La solución demostrada en GTC combinó:

- Nodo de cómputo de clúster GPU NVIDIA DGX Spark ejecutando inferencia a escala

- Supermicro JBOF como nivel de caché SSD NVMe en red de alta velocidad para mantener el contexto inmediato cerca de la computación.

- Disco duro Seagate JBOD para un nivel de almacenamiento de datos escalable y de alta capacidad para proporcionar contexto de larga duración a un precio asequible.

- DPU NVIDIA BlueField-3 o NVIDIA BlueField-4 para descargar y acelerar el movimiento de datos y el almacenamiento en caché entre el almacenamiento y la colocación directa de datos en la memoria de la GPU.

- Componentes de código abierto orquestados por DPU (NVIDIA Dynamo) para almacenar en caché de forma inteligente conjuntos de datos residentes en el disco duro a través de SSD.

Esta arquitectura es importante no solo porque amplía el contexto, sino también porque replantea la forma en que las organizaciones deben pensar sobre la economía de la inferencia de IA. Una vez que las cargas de trabajo de los agentes pasan a producción, la memoria y el movimiento de datos se convierten en elementos centrales para el rendimiento, el coste y la fiabilidad, y no solo para la calidad del modelo.

“La combinación de la capa de almacenamiento flash JBOF de Supermicro y la capa de discos duros de Seagate puede reducir drásticamente los costes de inferencia al tiempo que proporciona un alto rendimiento”, dijo Vik Malyala, presidente y director general para EMEA, y vicepresidente sénior de Tecnología e IA de Supermicro. “Esto es especialmente importante a medida que la IA con capacidad de gestión de agentes se adopta de forma generalizada y las cargas de trabajo de inferencia crecen exponencialmente.”

Convertir la memoria en una ventaja competitiva

He aquí un cambio que es fácil pasar por alto: la inferencia se está convirtiendo tanto en un problema de memoria como en un problema de computación. Las GPU son potentes, pero para ser productivas, necesitan que los datos correctos se les entreguen en el momento adecuado, a la velocidad adecuada y al coste adecuado.

Los agentes necesitan almacenar más contexto. Además de las indicaciones, deben llevar un registro de:

- Historial extenso de conversaciones y decisiones

- Políticas y procedimientos

- Conocimientos sobre el producto y la resolución de problemas

- Registros, tickets y telemetría

Intentar mantener todo eso en el nivel de acceso inmediato (memoria de GPU o almacenamiento totalmente flash) es como insistir en que toda una empresa funcione con envíos premium el mismo día: estupendo para unos pocos paquetes; financieramente absurdo a gran escala.

El enfoque ganador se basa en arquitecturas de almacenamiento permanente de múltiples niveles.

Por qué el almacenamiento multinivel es la solución práctica

Una pila de IA inteligente separa la memoria a corto plazo de la memoria a largo plazo y utiliza cada nivel para aquello para lo que mejor está diseñado:

- Niveles de acceso en tiempo real (memoria HBM de la GPU, DRAM de la CPU, SSD NVMe locales y de red): manejan el contexto actual: tokens activos, incrustaciones activas y datos a los que se accede con frecuencia.

- Niveles de capacidad (construidos a partir de discos duros): almacenan contexto a largo plazo: grandes conjuntos de datos, historiales de larga duración y memoria de agente extendida.

El valor para el negocio radica en un principio simple: automatizar la ubicación de los datos en todos los niveles. Mantienes las GPU ocupadas, los costos bajo control y el contexto es profundo.

Cómo las DPU optimizan el plano de datos

Históricamente, combinar los niveles de rendimiento y los niveles de capacidad para la IA ha sido complicado. A menudo requería sistemas de archivos propietarios complejos, una gran carga de CPU y una puesta a punto delicada, especialmente a medida que aumentaban los volúmenes de datos.

Eso está cambiando gracias a las unidades de procesamiento de datos (DPU).

Las DPU pueden descargar y acelerar el movimiento de datos, de modo que el sistema no consuma ciclos de CPU del host solo para reorganizar bytes. Permiten patrones de acceso al almacenamiento y a las redes de alta velocidad, y pueden ejecutar servicios estándar basados en Linux para el almacenamiento en caché, la estratificación, la resiliencia y la seguridad. En resumen, las DPU ayudan a que el almacenamiento de IA de múltiples niveles sea implementable y escalable.

Eso es lo que hace que un diseño de múltiples niveles sea viable a escala de producción.

Lo que permite la arquitectura de múltiples niveles

La arquitectura de Seagate, Supermicro y NVIDIA reúne los componentes esenciales necesarios para ampliar el contexto de la IA de forma rentable y a gran escala: Procesamiento mediante GPU para inferencia, discos duros para un contexto de alta capacidad y larga duración, SSD NVMe para acceso inmediato y DPU para coordinar el movimiento de datos y el almacenamiento en caché entre los distintos niveles.

Esa combinación fomenta los resultados comerciales que más les importan a los clientes.

Un contexto de agencia más profundo significa un mayor valor empresarial.

¿Qué implica este enfoque para los clientes?

1. Mejor memoria almacenada por el agente y mejores resultados.

Los agentes pueden acceder a muchos más datos históricos de los que caben en el almacenamiento adyacente a la GPU. Esto favorece un razonamiento a más largo plazo, una personalización más completa y menos fallos causados por el olvido del contexto.

2. Contexto de menor coste de escala

Los discos duros ofrecen un coste por TB considerablemente menor para el almacenamiento a largo plazo. Eso es importante porque los conjuntos de datos y los historiales de los agentes crecen continuamente.

3. La eficiencia como la próxima frontera de la optimización

Las organizaciones realizan un seguimiento del rendimiento (tokens por segundo), así como de la eficiencia, incluyendo métricas como la potencia por token y la utilización sostenida de la GPU. Los diseños de múltiples niveles ayudan a reducir el trabajo innecesario (recarga, reprocesamiento, recuperación) y a mantener la productividad de las GPU.

4. Alineación con la dirección que está tomando la infraestructura de IA.

Los planos de datos controlados por DPU se están convirtiendo en un elemento central del diseño de los sistemas de IA modernos. Este enfoque se alinea con esa dirección: construir soluciones para la entrega de datos escalable, no solo para la computación pura.

Pruebas, no promesas: La demo de GTC y lo que viene después

En GTC, esta arquitectura se demostró en un sistema en funcionamiento, con GPU para inferencia, discos duros para contexto profundo y masivo, SSD para acceso inmediato y DPU que orquestan el movimiento y el almacenamiento en caché eficientes de los datos.

La inteligencia artificial aún se encuentra en una fase temprana de desarrollo. Seguirá consumiendo y generando enormes volúmenes de datos. En colaboración, Seagate, Supermicro y NVIDIA están haciendo posible ese futuro con arquitecturas más sostenibles, más eficientes y diseñadas para la escalabilidad.

Las organizaciones que logren escalar sus agentes con éxito serán aquellas que traten el contexto como un activo estratégico y que construyan una infraestructura capaz de almacenar y servir ese contexto de manera eficiente.

Hable con un experto sobre cómo Seagate puede permitir que su organización escale la pared del contexto de agentes.