エンタープライズ

Seagateシステムのサポート

国/地域を選択してください

Asia-Pacific (APAC)

Europe

Middle East/North Africa

Latin America

North America

Log in

Seagate Partner Programポータル

VAR、インテグレータ、リセラー、その他チャネル・パートナー向けの製品トレーニング、販売およびマーケティング・リソース、案件登録などのサービスにアクセスできます。

Seagateダイレクト顧客向けポータル

ダイレクト顧客の皆様に価格設定、プログラム、注文、返品、請求などのB2Bセルフサービス型ツールを提供しています。

Seagateサプライヤ向けポータル

ニーズに応えるセルフサービス型のツールをサプライヤの皆様に提供しています。

マイ・プロフィール

View/edit your profile information

マイ・ダッシュボード

View your dashboard

ログアウト

Logout of your account

- Seagateブログ

-

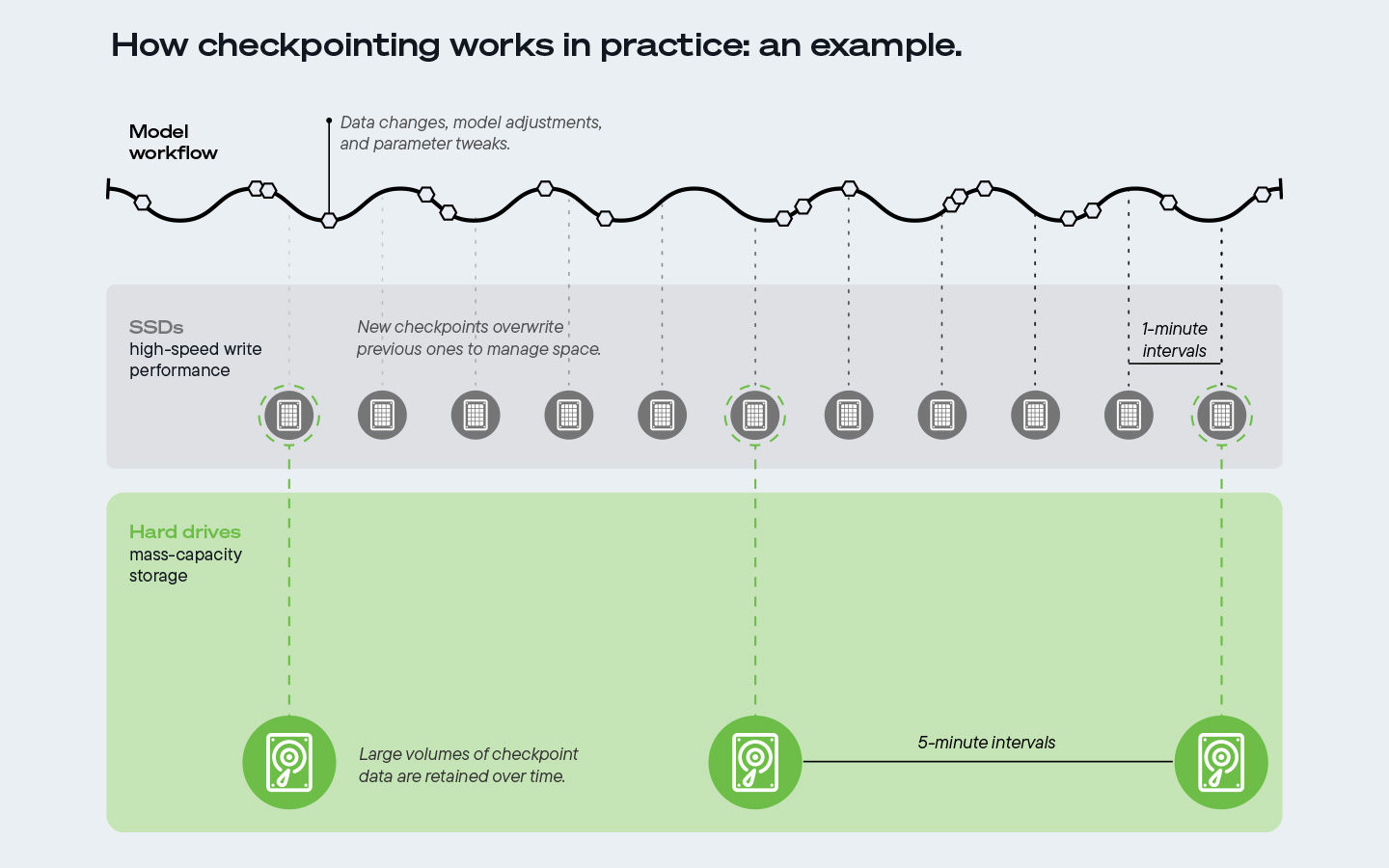

AIインフラストラクチャ用ストレージに対するニーズの変化